微软宣布开发一个小型的、本地运行的人工智能语言模型家族,名为Phi-3 mini。在arXiv预印本服务器上发布的技术报告中,新SLM背后的团队将其描述为比其他尺寸的SLM更强大,比大型模型更具成本效益。他们还声称,它的性能优于同级别的许多机型,甚至一些更大的机型。

正如新型号发布时所指出的那样,slm正在开发中,以允许本地运行应用程序,这意味着它们可以在未连接到互联网的设备上运行。同样在新版本中,微软将Phi-3迷你应用程序描述为3.8B语言模型——一个表示应用程序可以使用的参数数量的数字。

参数越多,模型就越强大。例如,GPT-4据信有超过1万亿个参数,这需要大量的计算能力,这也解释了为什么它不能在本地运行。

微软还指出,新的SLM是使用3.3万亿个代币进行训练的,这意味着尽管它的体积很小,但它仍然可以提供合理程度的人工智能。他们还指出,Phi-3是去年向公众发布的两款早期型号Phi-1和phi - 2的升级版。

微软在声明中称,Phi-3模型的性能可与GPT-3.5和其他一些llm相媲美。他们说,与其他小型号相比,用户会发现它们“非常好”。据报道,它们将在一台只有8GB内存的电脑上运行。

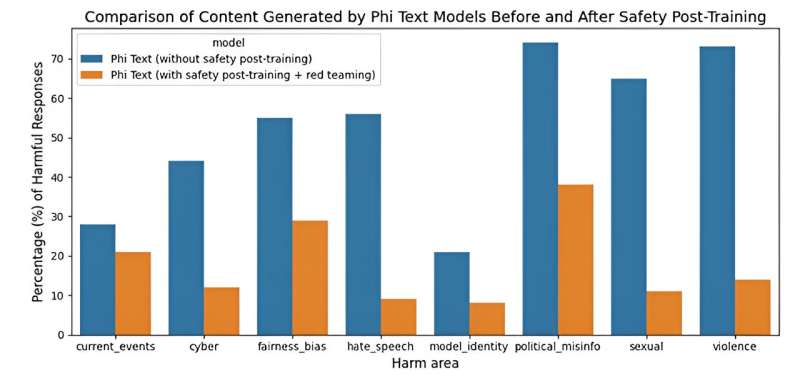

该团队还指出,尽管它们的规模很大,但它们能够通过使用特别高质量的数据来训练它们,包括过滤的网络数据和教科书中的信息,从而实现如此好的表现。他们还增加了新的功能,以提供更强大,安全和愉快的交互式用户体验。

微软已经向任何选择试用的人免费提供了新模型——它们都可以从该公司在Azure上的云服务下载,也可以通过合作公司网站下载。它们可以在mac和pc上运行。

更多信息:Marah Abdin等人,Phi-3技术报告:手机上的高性能语言模型,arXiv(2024)。DOI: 10.48550 / arxiv.2404.14219

huggingface。ini-4k- instruct_gguf . co/microsoft/Phi-3

Techcommunity.microsoft.com/t5….. http:// /ba-p/4121315

Azure.microsoft.com/en-us/blog…-possible-with-slms/

期刊信息: arXiv©2024 Science X Network

引用:微软声称小的、本地化的语言模型也可以很强大(2024,4月24日 作品受版权保护。除为私人学习或研究目的而进行的任何公平交易外,未经书面许可,不得转载任何部分。的有限公司 内容仅供参考之用。