本周,在第38届国际机器学习会议(ICML 21)上,纽约大学坦顿工程学院网络安全中心的研究人员揭示了神经网络对加密数据进行推理的基本功能的新见解。

在论文“DeepReDuce: ReLU Reduction for Fast Private Inference”中,该团队专注于线性和非线性算子,这是神经网络框架的关键特征,根据操作的不同,会在时间和计算资源上造成很大的损失。当神经网络对加密数据进行计算时,其中许多代价是由线性激活函数(ReLU)这一非线性操作引起的。

计算机科学与工程、电子与计算机工程教授布兰登·里根(Brandon Reagen)和一组合作者,包括博士生南丹·库马尔·杰哈(Nandan Kumar Jha)和扎赫拉·戈西(Zahra Ghodsi),后者曾在西达尔特·加格(Siddharth Garg)的指导下攻读博士学位,开发了一个名为DeepReDuce的框架。通过神经网络中ReLUs的重排和降低,给出了一种解决方案。

里根解释说,这种转变需要从根本上重新评估神经网络系统中有多少组成部分分布在哪里。

他解释说:“我们正在尝试重新思考神经网络的设计方式。”“你可以跳过这些时间和计算昂贵的ReLU操作,但仍然可以以2到4倍的运行时间获得高性能网络。”

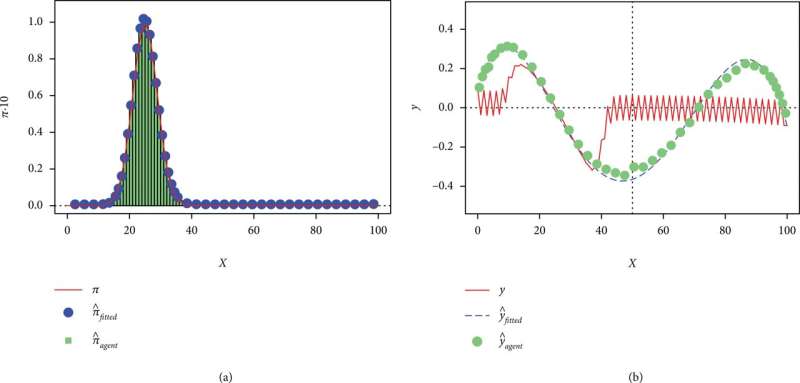

该团队发现,与最先进的私人推理相比,DeepReDuce提高了准确率,并分别减少了3.5%和3.5倍的ReLU数量。

这项研究不仅仅是学术性的。随着人工智能的使用与人们对个人、企业和政府数据安全的担忧同步增长,神经网络越来越多地利用加密数据进行计算。在这种情况下,涉及到神经网络对隐藏数据产生私人推断(PI’s)而不披露输入,非线性函数在时间和功率上施加最大的“代价”。因为这些成本增加了学习机器做PI的难度和时间,研究人员一直在努力减轻ReLUs在这类计算上施加的负载。

该团队的工作建立在名为CryptoNAS的创新技术之上。描述早期论文的作者包括Ghodsi和第三个博士生,Akshaj Veldanda, CryptonAS优化ReLUs作为一个可能的使用对岩石重新排列在一个优化水流流:现实的分布网络和删除冗余ReLUs ReLUs。

DeepReDuce通过进一步简化流程对CryptonAS进行了扩展。它包括一组优化,用于在CryptonAS重组功能后明智地删除ReLUs。研究人员通过使用DeepReDuce从经典网络中移除ReLUs来测试它,发现它们能够在保持高准确性的同时显著减少推理延迟。

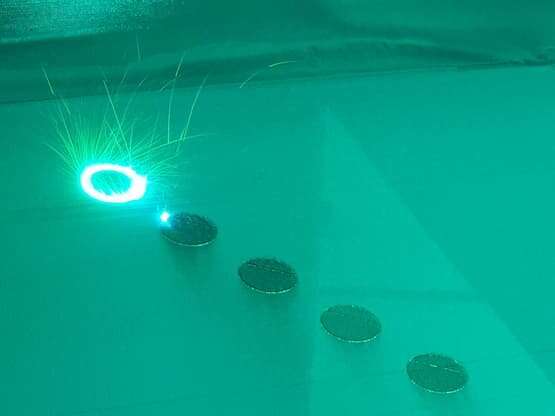

里根还与电子与计算机工程研究助理教授米哈里斯·马尼塔科斯(Mihalis Maniatakos)合作,与数据安全公司Duality合作,设计一种新的微芯片,用于处理完全加密数据的计算。